近日,

一位女網(wǎng)友在網(wǎng)上曬出

自己在地鐵列車的照片

被別有用心的網(wǎng)友下載,

并用AI技術(shù)“一鍵脫衣”,

且將“除衣”后的照片

廣泛傳播。

▽

女網(wǎng)友表示將維權(quán)處理

記者發(fā)現(xiàn),網(wǎng)絡(luò)上仍存在不少非法網(wǎng)站提供“一鍵脫衣”的AI技術(shù),并且這些技術(shù)主要針對女性。

記者注意到,這名女網(wǎng)友是一名穿搭博主。2022年7月8日,她在社交平臺發(fā)布了一組在地鐵列車上拍攝的穿搭照片。

不過,近日有人將該照片上人物的衣物去除后,在網(wǎng)上惡意傳播,稱有人在地鐵上拍攝裸照。不少網(wǎng)友對此十分憤慨。

該照片的背景和博主上傳的照片背景一致,頭像也一致,唯一不同的是博主原本穿的衣服卻不見了。

記者注意到,已有不少網(wǎng)友涌入該博主照片的評論區(qū),稱有人惡意使用這張照片P圖并傳黃謠。

AI“一鍵脫衣”技術(shù)讓不少網(wǎng)友感到氣憤,有網(wǎng)友在評論區(qū)十分擔(dān)憂地表示:“AI犯罪要來了嗎?”

死灰復(fù)燃的AI脫衣

偽造謠言百口莫辯

早在2019年,國外程序員就開發(fā)出了DeepNude這款使用AI技術(shù)“脫衣”的應(yīng)用,通過使用類似deepfakes的深度學(xué)習(xí)技術(shù),DeepNude使用女性裸照訓(xùn)練之后可將圖像中女性身上的衣服替換掉,創(chuàng)造出幾可亂真的合成裸照,也就是大家所說的“一鍵脫衣”。

后因廣泛的輿論爭議,開發(fā)團隊選擇將該項目關(guān)閉。

但記者發(fā)現(xiàn)在網(wǎng)上搜索“AI脫衣軟件”仍然會出現(xiàn)眾多“替代品”。

有些非法在線網(wǎng)站甚至公然介紹,該網(wǎng)站可以“使用AI算法的強大功能為照片脫衣服”,并提供“免費下載,免費試用”的功能。

更為惡劣的是,即使上傳的是男性的照片,這些網(wǎng)站仍會將照片上的人物P上女性的裸體。

非法網(wǎng)站公然宣告提供“脫衣服”功能

有博主發(fā)視頻表示,在現(xiàn)今AI強大的算法下,時間、地點都對得上的情況下,偽造的謠言讓普通人百口莫辯。

AI換臉換裝

或涉嫌刑事犯罪

近年來,“AI換臉”走紅網(wǎng)絡(luò),一些“AI換臉”的App使用明星的圖片制作換臉視頻進行推廣,其趣味性背后暗藏不少法律風(fēng)險和侵權(quán)糾紛。

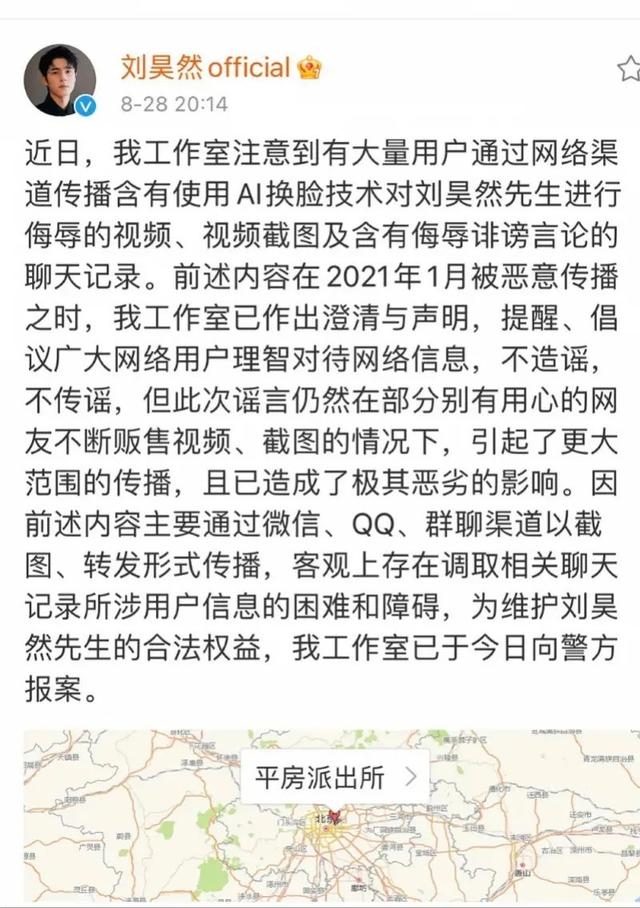

明星劉昊然就曾在2021年8月26日發(fā)博打假,控訴網(wǎng)上流傳的某淫穢視頻為AI換臉技術(shù)偽造,并向警方報案。

專家表示,在《網(wǎng)絡(luò)安全法》第二十七條的規(guī)定當(dāng)中,特別強調(diào),明知他人實施危害網(wǎng)絡(luò)安全活動的,不能夠為他提供技術(shù)支持,如果情節(jié)嚴(yán)重,還會構(gòu)成幫助信息網(wǎng)絡(luò)犯罪活動罪等刑事犯罪。

網(wǎng)友評論

惡心的不是技術(shù)而是人

隱私不雅照片在互聯(lián)網(wǎng)上被曝光,對于任何人而言,都是對個人權(quán)益的肆意侵犯,也可能帶來一連串的不良后果,嚴(yán)重的時候,可能導(dǎo)致當(dāng)事人“社會性死亡”。

而利用偷拍加軟件處理,就可以制造他人的不雅照片和視頻,這種極度輕易的造假,無疑是非常邪惡和可怕的,可以說是誅心之舉。

被“一鍵脫衣”造謠的人,可能在毫不知情,也沒有任何不當(dāng)之舉的情況下,被人以惡意的眼光審視和意淫,名譽被損毀,社會評價被降低,可能還會影響到正常生活和工作等等,簡直可以說是無妄之災(zāi)。

技術(shù)本身并沒有善惡之分,但是一旦有人惡意地使用技術(shù),就可能造成非常可怕的后果。

今年1月10日開始施行的《互聯(lián)網(wǎng)信息服務(wù)深度合成管理規(guī)定》中提出,要對深度合成技術(shù)應(yīng)用提出規(guī)范。那么,法律規(guī)范是至關(guān)重要的一環(huán)。

希望各地的公安機關(guān)和監(jiān)管部門都能盡快出手,打擊和清理不法軟件,依法懲處違法犯罪分子,斬斷背后的黑灰產(chǎn)業(yè)鏈,讓新技術(shù)能在法治軌道上健康發(fā)展,為人類生活謀福利,而不是讓新技術(shù)成為傷害無辜者、污染社會風(fēng)氣的定時炸彈。

來源:極目新聞、涇渭視頻、央視網(wǎng)、新聞晨報、網(wǎng)友評論

編輯:龔紫珺